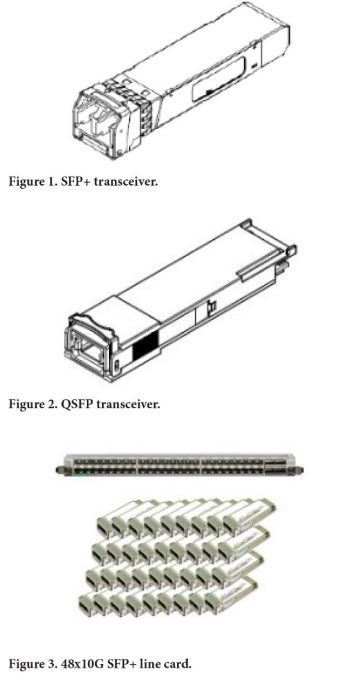

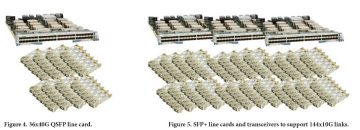

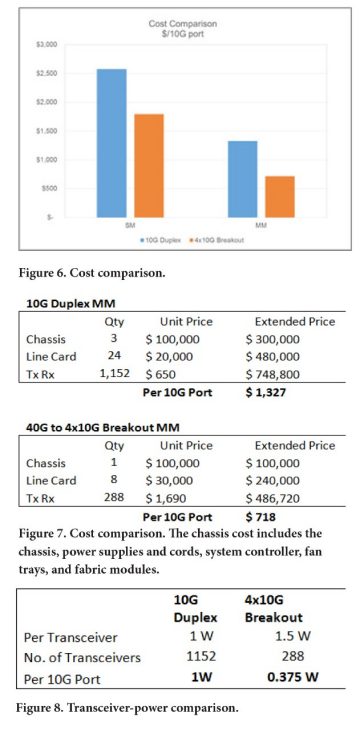

Port-Breakout-Implementierungen sind zu einem beliebten Netzwerk-Tool geworden und treiben die große Nachfrage der Industrie nach parallel-optischen Transceivern voran. Heutzutage wird ein Port-Breakout üblicherweise verwendet, um parallel-optische Transceiver mit 40/100Gbps (40/100G) als vier diskrete Links mit jeweils 10/25Gbps (10/25G) zu betreiben. Ein Breakout paralleler Ports ist vorteilhaft für mehrere Anwendungen, wie z. B. den Aufbau groß angelegter Leaf-Spine-Netzwerke und die Realisierung der heutigen 10/25G-Netzwerke mit hoher Dichte. Letztere Aufgabe steht im Fokus dieses Artikels.

Der Cisco Visual Networking Index sagt voraus, dass der IP-Verkehr von 2015 bis 2020 mit einer durchschnittlichen jährlichen Wachstumsrate von 22 Prozent zunehmen wird, angetrieben durch das rasante Wachstum bei kabellosen und mobilen Geräten. All diese Daten führen zu Wachstum sowohl in Unternehmens- als auch in Cloud-Rechenzentren. Dieses Wachstum erklärt, warum Rechenzentren oft die ersten Anwender der schnellsten Netzwerkgeschwindigkeiten sind und konsequent nach Lösungen suchen, mit denen Schrank- und Stellflächen eingespart werden können. Vor nur wenigen Jahren fand in der Welt der strukturierten Verkabelung eine Dichte-Revolution statt, bei der die Dichte der passiven optischen Rechenzentrums-Hardware auf 288 Glasfaser-Ports mit LC- oder MTP-Anschlüssen in einem 4HE-Gehäuse verdoppelt wurde. Dieser Anstieg hat sich nun auf die Switching-Seite übertragen, wo der Einsatz einer Port-Breakout-Konfiguration die Port-Kapazität einer Switch-Line-Card, die in einem 10G- oder 25G-Netz arbeitet, bis zu verdreifachen kann.